Tutto pronto per l’incontro di Bletchley Park. I Sette pubblicano un codice di condotta per guidare le aziende nel periodo di transizione. La Casa Bianca rilancia potenziando i controlli su chi sviluppa i modelli e affrontando la questione dall’ottica della sicurezza nazionale. Roma, Parigi e Berlino consolidano la cooperazione

Conviene agire velocemente e in maniera coordinata per regolamentare l’intelligenza artificiale, che promette di essere una delle tecnologie più rivoluzionarie del secolo. Questo sembra essere il mantra dei governi occidentali, che alla vigilia del primo Summit sulla sicurezza dell’IA – in programma a Bletchley Park, nel Regno Unito, i giorni 1 e 2 novembre – si muovono in parallelo per stabilire le regole che indirizzeranno l’evoluzione dell’IA. Nella giornata di lunedì è stata la volta dei Paesi del G7 e degli Stati Uniti d’America, ma anche del triangolo Italia-Francia-Germania, le prime tre economie dell’Ue che hanno promesso di intensificare la collaborazione in questo ambito.

DAL CODICE DEL G7…

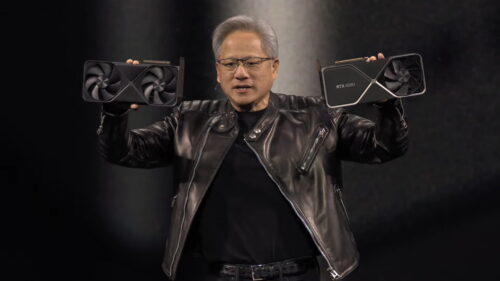

Lunedì il Gruppo dei Sette ha pubblicato il suo codice di condotta per le aziende che sviluppano sistemi avanzati di IA. Si tratta del compimento di una promessa fatta a maggio, durante il Summit dello scorso maggio, quando i ministri del G7 hanno dato l’avvio al Processo di Hiroshima sull’IA. Questo codice di condotta volontario ne è il primo risultato e vuole essere un punto di riferimento per la gestione dell’IA, un “decalogo” fondamentale in undici punti, per “promuovere un’IA sicura, protetta e affidabile in tutto il mondo” e fornire “una guida volontaria” alle aziende che sviluppano i sistemi IA più avanzati.

L’approccio suggerito nel codice è quello di basarsi sul rischio, lo stesso approccio dei futuri regolamenti europei e non solo. L’esortazione del G7 alle aziende è quella di utilizzare queste linee guida mentre i governi sviluppano leggi più longeve e dettagliate. Da parte loro, gli addetti ai lavori del G7 si impegnano a sviluppare proposte (in coordinamento con Ocse e altri) per creare strumenti e meccanismi di monitoraggio e trasparenza. Ambiti in cui le stesse aziende dovrebbero già muoversi autonomamente, spiegando al pubblico tramite appositi rapporti cosa siano in grado di fare i propri modelli e approntando misure per rispondere alle criticità che emergeranno durante il loro utilizzo.

Le indicazioni contenute nel codice trattano di questo. L’idea è mettersi nelle condizioni di “identificare, valutare e mitigare il rischio lungo l’intero ciclo di vita dell’IA”, agendo per contrastare i casi noti di abuso dei modelli e sviluppando assieme alle autorità dei sistemi di condivisione delle informazioni sugli incidenti. In parallelo, le aziende dovrebbero sviluppare, implementare e rendere pubbliche le loro regole e dotarsi di “robusti controlli” di sicurezza, ma anche “etichette” digitali con cui identificare contenuti generati dall’IA e misure di protezione dei dati personali e della proprietà intellettuale.

È tutto sotto l’egida della mitigazione del rischio, ma ci sono anche passaggi che guardano alle potenzialità di questa tecnologia con più ottimismo: il punto 9 parla di prioritizzare “lo sviluppo di sistemi avanzati di IA per affrontare le sfide più importanti del mondo”, specialmente “la crisi climatica, la salute globale e l’istruzione”, mentre il punto 10 invita le aziende a “promuovere lo sviluppo e […] l’adozione di standard tecnici internazionali”, che poi sarebbero il presupposto per rendere questi sistemi globali e favorire la loro apertura, sulla falsariga di quella parte di internet che rimane libero e aperto e non soggiace ai desiderata di singole entità autocratiche.

… ALLA MOSSA DELLA CASA BIANCA

Nelle stesse ore l’amministrazione statunitense ha compiuto un passo in più rispetto al codice di condotta del G7. Come previsto, il presidente Joe Biden ha firmato un executive order (da 110 pagine) per far rientrare l’IA nell’ambito della sicurezza nazionale, volto ad affrontare i rischi ma anche sfruttare i vantaggi di questa tecnologia. Il documento copre un’ampia varietà di aspetti, dalla sicurezza alla privacy e all’impatto della tecnologia sulla forza lavoro statunitense: un riconoscimento di quanto potrebbe essere profondo lo sconvolgimento che comporterà la rivoluzione IA.

Il documento formato da Biden tratta di tradurre in pratica alcuni dei principi previsti dal codice del G7. La Casa Bianca ha imposto una serie di controlli alle aziende che sviluppano i sistemi IA più avanzati, che dovranno “condividere con il governo federale i risultati dei test di sicurezza condotti da terzi” ma anche avvisare quando clienti stranieri vorranno usare servizi da remoto (cloud) per addestrare modelli IA che “potrebbero essere utilizzati in attività malevole di tipo informatico”.

Il dipartimento del Commercio Usa è già al lavoro per creare le “etichette” per i contenuti generati dall’IA, ma quel sistema rimane volontario (per ora). L’executive order di Biden dovrebbe anche indicare al dipartimento della Salute di istituire un programma per ricevere segnalazioni di pratiche sanitarie non sicure che coinvolgono l’IA, e al dipartimento del Lavoro di studiare il potenziale impatto della tecnologia sul mercato del lavoro e sviluppare sistemi per sostenere i lavoratori che subiranno la rivoluzione. Infine, la Casa Bianca prevede di favorire l’immigrazione di lavoratori altamente qualificati nel settore per mantenere il vantaggio accademico e tecnologico degli Stati Uniti.

PAROLA D’ORDINE: CONVERGENZA

Come per l’adozione di regole sul 6G e i flussi di dati transfrontalieri (tema dove Ue e Usa divergono nel metodo), l’approccio del G7 sull’IA è predicato sulla creazione di un fronte comune. L’urgenza è anche di natura geopolitica, considerando che anche la Cina sta investendo miliardi nello sviluppo dei propri modelli di IA – ma tarati sui valori e l’dea di gestione dei dati personali del Partito comunista cinese. Nel lavorare congiuntamente sul disegnare il futuro dell’IA, i governi occidentali puntano a diffondere regole che mantengano questa tecnologia nell’alveo delle logiche democratiche. Ed è in questo sforzo che rientra la promessa tra Francia, Germania e Italia (che l’anno prossimo prenderà il testimone della presidenza del G7 dal Giappone) di irrobustire la cooperazione e fare sistema per affrontare la rivoluzione IA “con una visione condivisa”, nelle parole del ministro delle Imprese Adolfo Urso dopo la conclusione del trilaterale con i colleghi di Parigi e Berlino, Bruno Le Maire e Robert Habeck.