Supremazia tecnologica, attrazione dei migliori cervelli stranieri e protezione dei valori americani sono tre fra i principi che stanno alla base della strategia Usa per l’Ai. L’analisi di Andrea Monti, professore incaricato di Digital Law nell’università di Chieti-Pescara

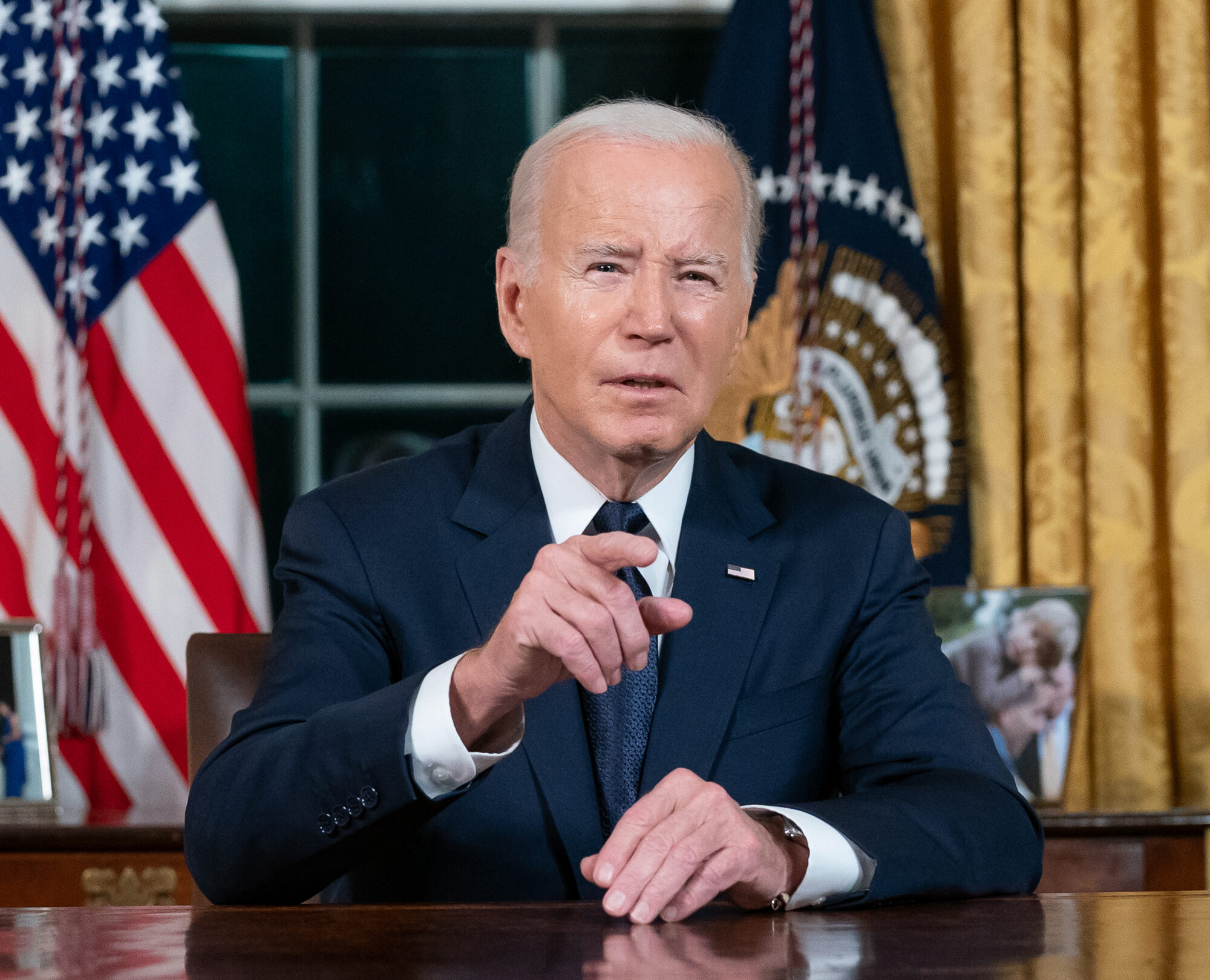

L’Executive Order on the Safe, Secure, and Trustworthy Development and Use of Artificial Intelligence emesso lo scorso 30 ottobre 2023 dal presidente Biden definisce la posizione dell’esecutivo statunitense rispetto al tema dell’intelligenza artificiale, a partire proprio dalla scelta di uno strumento giuridico “d’urgenza” che, in attesa di un intervento normativo del Congresso, detta la linea da seguire nell’immediato orientando in modo coerente l’operato di tutta l’amministrazione.

Il provvedimento è particolarmente articolato e complesso, pertanto questa analisi sarà limitata ai soli aspetti di sistema che riguardano il posizionamento dell’AI nella visione geopolitica statunitense.

Il primo tema trattato è quello della supremazia tecnologica: La velocità con la quale stanno crescendo le capacita dell’AI”, si legge, “impone agli Stati Uniti di assumere la guida nell’interesse della nostra sicurezza, dell’economia e della società.”

In un curioso parallelismo con l’analogo atto adottato dal governo cinese, anche l’executive order affronta il tema dell’importanza di tutelare la priorità dei valori nazionali (Usa, nel caso di specie) come elemento costitutivo delle scelte politiche sull’intelligenza artificiale: “L’intelligenza artificiale riflette i principi delle persone che la costruiscono, di quelle che la usano e dei dati su cui è costruita. Sono fermamente convinto che la forza dei nostri ideali, le fondamenta della nostra società e la creatività, la diversità e la decenza della nostra gente siano le ragioni per cui l’America ha prosperato in epoche passate di rapido cambiamento.”

Dal punto di vista delle relazioni interne e internazionali, la scelta dichiarata è quella di una piena autonomia decisionale rispetto a società civile, alleati e partner le cui posizioni saranno prese in considerazione “as feasible”, con ciò stabilendo la non negoziabilità delle decisioni esecutive.

Questo principio sostiene il successivo, che attribuisce priorità alla tutela della sicurezza nazionale e delle tecnologie di punta nella gerarchia degli interessi in gioco dal momento che la situazione “richiede anche di affrontare i rischi più pressanti per la sicurezza dei sistemi di IA – anche per quanto riguarda la biotecnologia, la sicurezza informatica, le infrastrutture critiche e altri pericoli per la sicurezza nazionale – navigando al contempo nell’opacità e nella complessità dell’IA.”

Di particolare interesse è la scelta di promuovere il brain poaching su studenti e ricercatori stranieri in modo da attrarli permanentemente negli Usa — e dunque sottrarli ai Paesi di provenienza. Il testo dell’ordine esecutivo è estremamente esplicito sul punto: “La mia Amministrazione sosterrà programmi per fornire agli americani le competenze necessarie per l’era dell’IA e per attirare i talenti mondiali dell’IA sulle nostre coste – non solo per studiare, ma per restare – in modo che le aziende e le tecnologie del futuro siano made in America”.

I principi appena esposti costituiscono le basi per ottenere la leadership sulla regolamentazione globale. L’esecutivo Biden sarà parte attiva nel gestire le scelte regolatorie insieme ad altre nazioni “inclusi anche i nostri concorrenti” (non è difficile leggere questo inciso come un sinonimo per “Repubblica Popolare Cinese”). Ed è proprio questo ultimo punto che potrebbe trasformarsi in un nuovo teatro di contrasto invece che di collaborazione.

Come detto, sia gli Usa sia la Cina hanno posto alla base delle proprie scelte politiche la tutela dei rispettivi valori e della propria sicurezza nazionale che sono, sostanzialmente e comprensibilmente, non negoziabili. Dunque, il riferimento esplicito al contenimento delle minacce dell’AI per i diritti umani —categoria giuridica eminentemente occidentale da tempo weaponizzata— potrebbe compromettere l’intenzione pur commendevole di arrivare a una sorta di tregua pre-competitiva.

(N.d.r.: Le traduzioni dell’executive order non sono ufficiali)