In Italia e in Europa sta pericolosamente prevalendo la preoccupazione della tutela prima ancora che lo sviluppo di ciò che dovrebbe minacciarci, con il vero rischio nel prossimo futuro di doverci difendere da intelligenze artificiali americane o cinesi. Il tema etico è importante? Importantissimo. Servono regole? Nessuno lo mette in dubbio. L’intervento di Giovanni Iozzia, direttore Economyup.it e vicepresidente Fondazione Pensiero Solido

La diffusione dell’intelligenza artificiale comporta rischi? La prima a rispondere sì, facendone un lungo elenco è ChatGPT. Il problema è che i rischi sono allo stesso tempo il tema prevalente della narrativa del grande cambiamento ma anche una sua funzione.

In altri termini: rischiamo di più a non affrontare con lucidità, tempestività e convinzione la sfida che ad usare l’AI e le sue applicazioni. Sì, c’è una importante questione di parole e dei sentimenti che producono.

Ricordate la famosa lettera del marzo 2023, firmata da Elon Musk e altri mille, con la sorprendente (e sospetta) richiesta di sospendere lo sviluppo delle intelligenze artificiali? È diventata il manifesto di tutti i doomer (il termine deriva da doom- catastrofe – e viene usato per definire una persona che vede gli effetti negativi della vita, sia nel mondo reale sia online).

“Non è così che possiamo mitigare i rischi delle intelligenze artificiali anche perché, signori, il modo in cui ne state parlando è altrettanto pericoloso”, ha detto al New York Magazine la linguista computazionale Emily M. Bender. Quindi dobbiamo tutti impegnarci a parlarne in un modo più sicuro, salubre e consapevole.

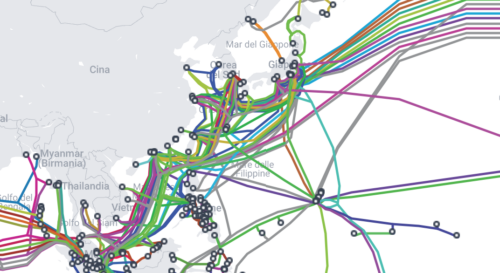

Ci occupiamo ancora troppo dei rischi dell’intelligenza artificiale nella nostra conversazione sociale, finendo per trascurare le opportunità e le azioni da fare per coglierle. Ne parliamo come se fosse un’entità autonoma, una potenza straniera, dimenticando che è il prodotto di aziende con legittimi interessi economici che, come tali, vanno eventualmente regolati, contemperati, valutati nei loro impatti sociali e, se ci sono competenze e risorse, contrastati nel mercato. Ed è proprio questo il nostro punto debole e il plurale sta per quello che dovrebbe essere l’abituale quadro di riferimento: l’Unione Europea.

In Italia e in Europa sta pericolosamente prevalendo la preoccupazione della tutela prima ancora che lo sviluppo di ciò che dovrebbe minacciarci, con il vero rischio nel prossimo futuro di doverci difendere da intelligenze artificiali americane o cinesi. Il tema etico è importante? Importantissimo ma, ad esempio, Google ha definito i propri principi già nel 2018. Servono regole? Nessuno lo mette in dubbio e l’Europa può vantare il primato di un quadro normativo, guarda caso, tutto centrato sulla mitigazione dei rischi. Intanto lo sviluppo della tecnologia e dei business collegati è tutto in mano agli Stati Uniti (molto meno sappiamo su quanto accade in Cina, dove però fermi non sono….).

La filiera dell’AI nel Vecchio continente è ancora debole, per scarsità di investimenti, frammentazione dei mercati, velocità inadeguata alla stessa evoluzione della tecnologia. In Italia, non va molto meglio: i capitali messi sul tavolo, anche nei piani del Governo, sono poca cosa rispetto alla posta in gioco.

C’è in questo momento una contraddizione irrisolta: preoccuparsi (giustamente) della sovranità tecnologica in un ambito strategico come l’intelligenza artificiale ma non decidersi a investire quello che serve, finendo per dipendere dai capitali americani.

In questo senso una buona notizia è il lancio di Italia, il primo LLM addestrato su testi e contenuti italiani, con un filtro etico: un progetto dell’azienda jeep-tech iGenius sviluppato in collaborazione con il consorzio Cineca e il supporto del super calcoltare nazionale Leonardo. Dobbiamo augurarci che possa contare sul sostegno e le risorse necessarie per crescere, svilupparsi e conquistare uno spazio di mercato.

Al di là delle questione geopolitiche, per l’Italia la grande opportunità poco segnalata e ricercata è il recupero di produttività e competitività. Gli ultimi dati Istat ci ricordano che il Pil è ai livelli del 2007, con 12 anni di ritardo su Francia e Germania, e che dal 2000 è stato perso un quinto della produzione industriale. Tutte le ricerche e le analisi dicono che l’AI, se ben utilizzata, è un potente abilitatore di innovazione e di valore ( tra i 6 gli 8 trilioni di dollari a livello globale secondo la Accenture Technology Vision 2024).

Prima ancora di domandarci se l’intelligenza artificiale ci sostituirà dovremmo domandarci: vogliamo essere giudici con un alto senso etico o diventare anche produttori di innovazione capaci di stare sul mercato? Vogliamo mantenere il controllo dei dati (l’oro del futuro…) del Made in Italy e di quelli ancora più preziosi della Pubblica Amministrazione o siamo già rassegnati a lasciarli in mano a colossi americani (nella migliore delle ipotesi)?

L’intelligenza artificiale che abbiamo cominciato a conoscere dall’autunno 2022 (lancio di ChatGPT) è solo l’assaggio di una rivoluzione destinata a cambiare economia, società, cultura. Normale e comprensibile che, come tutti i cambiamenti epocali, generi ansia e preoccupazione. Bisogna però decidere rapidamente se questa rivoluzione vogliamo affrontarla da protagonisti o subirla, nascondendoci magari dietro infiniti dibattiti, cavilli normativi e tormenti etici.

Se domandi a ChatGPT “l’intelligenza artificiale generativa sostituirà l’uomo?”, la risposta è assai diplomatica: “È improbabile che l’AI generativa sostituirà completamente l’uomo”. Perché? “La creatività umana, il giudizio etico, l’empatia e la capacità di comprendere contesti complessi rimangono aree in cui gli umani eccellono”. Ecco, dovremmo avere e diffondere questa consapevolezza suggerita da un algoritmo piuttosto che lanciare allarmi, generare paure, disegnare scenari apocalittici.

L’etica, le norme, la tutela dai rischi sono tutte cose importanti ma se non pensiamo anche alla formazione di chi deve entrare nel mondo del lavoro come anche di chi è già dentro, il vero rischio che corriamo è di diventare vigilantes di ricchezze altrui. Probabilmente non saremo sostituiti dall’intelligenza artificiale ma certamente saremo sostituiti da qualcuno che conosce e sa usare l’AI per fare il nostro lavoro.