Nella finzione cinematografica diretta da Paul Verhoeven, il film Robocop del 1987, si chiamava ED-209. Si trattava di un nuovo robot realizzato dalla multinazionale – immaginaria anch’essa – Omni Consumer Products. Nel lungometraggio il prototipo era destinato alla Polizia di Detroit. Era un robot d’assalto bipede, dotato di tre cannoncini automatici e di un lanciarazzi che, però, ancora pareva soffrire di qualche problema nella programmazione.

Ma oggi esistono veramente robot in grado di individuare e colpire bersagli nemici senza alcuna necessità di controllo da parte di esseri umani. Il Dipartimento della Difesa USA, nella Direttiva “3000.09 – “Autonomy in Weapons Systems” ha creato la categoria delle “armi autonome”: sistemi d’arma che sono capaci di “selezionare e attaccare gli obiettivi senza ulteriori interventi da parte di operatori umani.”

Dopo i film di fantascienza e le definizioni teoriche, sono già stati sviluppati i primi prototipi; oggi i primi robot armati autonomi sono già operativi. La sentinella robotica SGR-A1, nata da una collaborazione fra l’Università di Seoul e la Samsung viene già dispiegata dalla Corea del Sud per sorvegliare la zona demilitarizzata al confine con l’irrequieta Corea del Nord.

L’SGR-A1 è dotata di un sofisticato sistema di artificiale che gli permette di interpretare i segnali che gli arrivano dai propri sensori ottici, infrarossi, laser e radar, elaborarli secondo la propria programmazione, prendere decisioni “intelligenti” e mettere fisicamente in atto la propria risposta.

Se attivata in configurazione automatica, l’arma autonoma della Samsung individua gli esseri umani fino a 3 km di distanza all’interno della zona demilitarizzata e decide autonomamente se distruggerli o meno. Nessuno è autorizzato ad entrare nella fascia demilitarizzata, perciò il riconoscimento di un bersaglio si riduce alla capacità di individuare oggetti in movimento e di comprendere se questi sono esseri umani oppure animali o vegetazione mossa dal vento. Ma i sensori e gli algoritmi percettivi di cui è dotato il robot armato non sanno risolvere problemi decisivi nella tattica degli scontri armati. Ad esempio: come potrebbero distinguere tra una pattuglia armata che tenta un blitz dietro le linee sudcoreane e famiglie di dissidenti nordcoreani che fuggono dal regime?

Inoltre, gli SGR-A1 non sono in grado di conformare il proprio comportamento alle Convenzioni di Ginevra, distinguendo fra un nemico ostile e un soldato ferito e innocuo oppure che si è arreso. Né hanno il software necessario per valutare correttamente se aprire il fuoco contro una potenziale minaccia “possa causare perdite di vite umane o danni eccessivi ai civili rispetto al vantaggio militare che ne potrebbe derivare” (artt. 52 e 51.5.b del Protocollo aggiuntivo I alle Convenzioni di Ginevra).

Questo non è il solo sistema d’arma autonomo in circolazione. Un altro esempio è rappresentato dai sistemi antimissile già installati sulle nuove navi della Marina Militare degli Stati Uniti: sono da tempo in grado di individuare e colpire un oggetto volante in arrivo senza alcun intervento umano. L’esigenza di rendere la reazione automatica è dovuta alla necessità di abbattere i missili in arrivo nei pochi secondi utili che passano tra la prima rilevazione e il loro impatto. Ma l’intelligenza artificiale di cui sono dotati non permette loro di distinguere fra un aereo ostile e un aereo con difficoltà radio che impediscono di trasmettere il segnale codificato di riconoscimento. Per non parlare di aerei civili finiti fuori rotta per qualche avaria o in situazioni di emergenza.

La comunità scientifica internazionale ha avviato una campagna per una moratoria sulle armi autonome mirata a imporre una sospensione di qualsiasi attività finalizzata allo sviluppo, al dispiegamento sul campo ed all’uso di armi autonome almeno fino a quando le armi autonome non saranno in grado di esercitare una efficace valutazione della situazione in cui si trovano e di rispettare i protocolli delle convenzioni connesse al diritto bellico.

Ma il dibattito internazionale si è presto spostato su iniziative più radicali. Dopo la campagna Stop Killer Robots del 2012, nel luglio del 2015 è stata pubblicata una lettera aperta per richiedere la messa al bando totale e preventiva delle armi autonome. Negli ultimi mesi è stata sottoscritta da più di 20.000 firmatari, tra i quali figurano 3.000 ricercatori nei settori dell’intelligenza artificiale e della robotica.

La motivazione più evidente per la richiesta di messa al bando dei colleghi reali di ED-209 è il diritto fondamentale di ogni essere umano a non essere ucciso in modo arbitrario. Ma in questi giorni stanno emergendo considerazioni più sottili e fonte di maggiore preoccupazione.

È vero che, nel breve periodo, la sostituzione dei soldati con dei robot sul campo di battaglia potrebbe diminuire il numero dei morti e superare le limitazioni percettive, cognitive ed emotive dei comuni soldati. Ma gli aspetti negativi sopravanzano abbondantemente i presunti vantaggi.

Prima di tutto, la previsione di un numero minore di morti nel proprio esercito potrebbe spingere i centri decisionali a superare la paura di conseguenze politiche negative dovute al rientro di aerei carichi di bare. Su questo è emblematica l’evoluzione della politica delle amministrazioni americane nei conflitti in Afghanistan e Iraq.

Poi, regimi repressivi e gruppi terroristici ben organizzati potrebbero impadronirsi o dotarsi di armi come queste sul mercato illegale per lanciarle in operazioni non ufficiali o in attacchi terroristici. Questi robot dovranno essere integrati con meccanismi di autodistruzione e con componenti non riconducibili ai mandanti. Così, in caso di cattura, non sarà facile indurli a “parlare”…

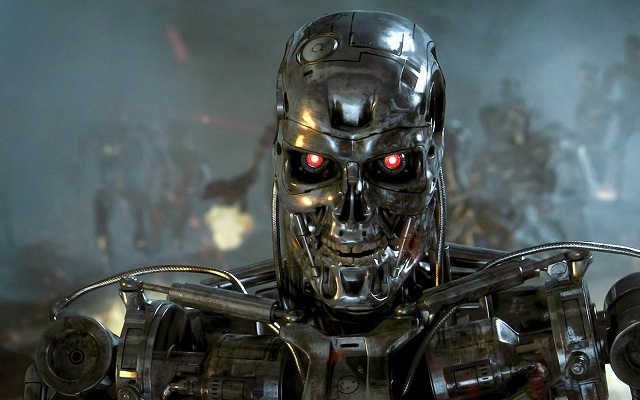

Questa evoluzione da Robocop a Terminator (il film di James Cameron del 1984) non è limitata alla fantascienza: da anni diversi eserciti impiegano sistematicamente droni telecomandati armati. Ma l’intelligenza artificiale necessaria per renderli autonomi è dietro l’angolo se non già disponibile, almeno per compiti specifici.

Infine, un motivo decisivo che spinge alla messa al bando di robot autonomi è dovuto proprio a rischi potenziali per la stabilità e la sicurezza internazionale: le armi autonome possono essere lanciate con accelerazioni incompatibili con la fisiologia umana e raggiungere obiettivi nucleari strategici nemici a velocità supersoniche. Un attacco repentino sui sistemi di armi di distruzione di massa dell’avversario lo renderebbe vulnerabile ad attacchi successivi annullando ogni possibilità di ritorsione nucleare. In queste condizioni, verrebbero meno le ragioni di deterrenza basate sulla teoria della Mutua Distruzione Assicurata che ci hanno permesso di sopravvivere alla guerra fredda e di arrivare vivi fino a oggi.