L’Intelligence Artificial Act presentato ad aprile dall’Ue per gli Stati Uniti è troppo stringente e rischia di minare lo sviluppo del settore. Quello a cui si punta è un’IA etica che non ostacoli le aziende, ma il nodo riguarda il come arrivarci. Le speranze sono riposte nella presidenza francese, ma nel frattempo a muoversi è la Cina

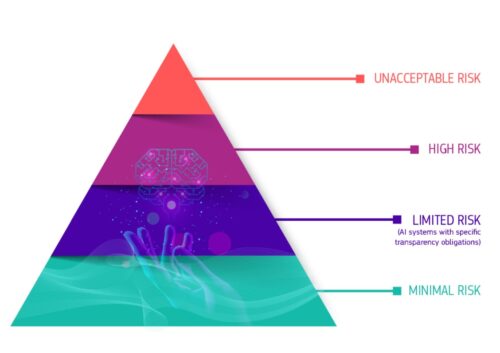

Sul sito della Commissione europea, nella sezione dedicata all’Intelligenza artificiale, troviamo una piramide, divisa per fasce di colori. La potremmo definire la piramide della discordia, dato che sembrerebbe rappresentare l’ostacolo principale che al momento allontana Bruxelles da Washington per la costruzione di una IA etica e condivisa.

Ognuno di questi colori, infatti, evidenzia i diversi rischi che i nuovi sistemi potrebbero causare nella società. Il rischio minimo è alla base della piramide. Man mano che si sale, l’entità del pericolo cresce: così, subito dopo il rischio minimo si passa uno limitato – che insieme comprendono la maggioranza delle tecnologie, su cui pendono poche restrizioni -, poi a uno elevato, fino ad arrivare alla punta del triangolo, nella fascia considerata “inaccettabile”.

Ognuno di questi colori, infatti, evidenzia i diversi rischi che i nuovi sistemi potrebbero causare nella società. Il rischio minimo è alla base della piramide. Man mano che si sale, l’entità del pericolo cresce: così, subito dopo il rischio minimo si passa uno limitato – che insieme comprendono la maggioranza delle tecnologie, su cui pendono poche restrizioni -, poi a uno elevato, fino ad arrivare alla punta del triangolo, nella fascia considerata “inaccettabile”.

Una definizione che spiega bene i limiti che la IA non dovrà mai superare, “dai sistemi di credito sociale utilizzati dai governi ai giocattoli con assistenza vocale che incoraggiano comportamenti pericolosi nei bambini”. Ancora più ampia è l’accezione di “rischio elevato” in cui il digitale può arrivare e che include, ad esempio, il punteggio degli esami che potrebbe escludere il cittadino dall’accesso all’istruzione o a una professione, l’applicazione della IA nella chirurgia robotica, i sistemi di credito sociale che negano la possibilità di un prestito o, ancora, il controllo lungo le frontiere.

Eppure, lo zelo dimostrato dall’Unione europea per promuovere nel continente sistemi di intelligenza artificiale “sicuri, trasparenti, etici, imparziali e sotto il controllo umano”, non sembra essere condiviso dagli Stati Uniti.

Il monito che arriva da Oltreoceano è molto semplice: nessuno si dice contrario a una regolamentazione, anche stretta, delle nuove tecnologie. Ma, come ha spiegato Eric Schmidt – che ha trascorso una vita ai vertici di Google e ha presieduto la Commissione di sicurezza nazionale degli Stati Uniti sull’IA -, seppur la legislazione europea “è sensata” pecca in un punto fondamentale: il voler regolamentare delle tecnologie difficili da identificare. “Oggi, non c’è nessuno sistema di IA in grado di spiegarsi da solo”, ha spiegato Schmidt. Questo perché semplicemente “la tecnologia non c’è”.

L’Artificial Intelligence Act presentato ad aprile dall’Unione europea, in sostanza, è un tentativo ambizioso, sicuramente necessario, ma che per i legislatori americani potrebbe paradossalmente bloccare lo sviluppo in quanto troppo restrittivo. Questo non significa che gli Stati Uniti stiano andando in una direzione totalmente opposta a quella europea. Sia l’amministrazione di Donald Trump – con le iniziative transatlantiche della Global Partnership on AI e la AI Partnership in Defense – sia quella attuale guidata da Joe Biden – con la National AI Initiative Act del 2020 – hanno dimostrato di avere a cuore lo stesso cruccio che si pongono a Bruxelles. Il nodo divisivo, tuttavia, riguarda il come arrivare a un’intelligenza artificiale sicura, eticamente giusta e che non influisca negativamente sulla vita dei cittadini.

L’incomprensione di fondo, però, apre nuovi orizzonti. Il non dialogo tra Buxelles e Washington non garantisce una collaborazione internazionale tra le democrazie in campo tecnologico e, come spesso accade, laddove manca l’Occidente arriva la Cina. A differenza dei suoi antagonisti, Pechino si sta facendo portavoce di una regolamentazione standard, basata sui suoi principi (autoritari, quindi). Questo vuol dire assumere una posizione di rilievo in un settore in gran parte ancora da regolamentare e la preoccupazione, statunitense tanto quanto europea, è che si instauri un “modello Cina”.

Tuttavia, ai timori non sta seguendo un dialogo costruttivo per impedire che ciò accada. Washington continua a chiedere ai suoi alleati di rivedere la propria regolamentazione, specialmente sui rischi elevati che potrebbero minare, o come scrivono dal Cepa, soffocare l’innovazione digitale. L’Europa, da parte sua, è impaurita che un uso deregolamentato della IA possa aumentare le discriminazioni razziali, di genere e anche economiche. Ciononostante, a novembre scorso, anche Human Rights Watch aveva da una parte apprezzato lo sforzo europeo di arrivare a una regolamentazione comune e, dall’altra, avvertito di come quella partorita non avrebbe tutelato a dovere i suoi cittadini. E allora qualcosa sembrerebbe muoversi.

I contatti tra i legislatori europei si stanno intensificando, con l’obiettivo di arrivare a un accordo comune entro aprile, a un anno dalla promulgazione dell’AI Act. Giovedì è trapelata una bozza di compromesso sugli articoli che vanno dall’8 al 15. Il più importante, l’articolo 9, riguarda proprio la gestione dei rischi: quelli ad alto rischio dovrebbero interessare solo quelli per “la salute, la sicurezza e i diritti fondamentali”, scrivono da Euractiv. Punti di incontro sembrerebbero esser stati trovati anche sulla governance dei dati (art.10) e sul controllo delle persone (art.14), in modo tale da attribuire chiare e proporzionate responsabilità. La questione più divisiva appare essere quella sul riconoscimento biometrico, con Ungheria, Polonia e Svezia a favore del suo utilizzo per controllare le proprie frontiere, anche nelle vicinanze dei confini esterni dove la legislazione europea non potrebbe arrivare. L’unica a dirsi convintamente contraria è stata la Finlandia, in quella che appare più come una questione politica che realmente digitale.

La macchina legislativa sta procedendo, dunque, molto lentamente e più il tempo passa più la mancanza di un’intesa collettiva rischia di diventare un pericoloso boomerang. Come spiegava al Wall Street Journal lo Chief Information Officer di BetterCloud, Thomas Donnelly, la nuova regolamentazione europea potrebbe avere un impatto negativo sul settore, in quanto le aziende preferirebbero migrare in altri Paesi dove i paletti sono meno stringenti. L’Unione europea, pertanto, è chiamata a trovare un giusto equilibrio, che permetta di tutelare gli utenti e allo stesso tempo non rallenti lo sviluppo del settore.

Per tale ragione il CEN e il CENELEC hanno dato vita al CEN-CENELEC 21 “Artificial Intelligence”, che riunisce esperti in materia in grado di fornire risposte al Libro Bianco dell’Ue, redatto dalla Commissione europea nel febbraio di due anni fa. Un’accelerazione potrebbe arrivare dalla presidenza francese, dal primo gennaio alla guida dell’Ue, che fa del digitale uno dei punti principali della sua agenda politica. Per il presidente Emmanuel Macron è importantissimo che le partite del Digital markets act (Dma) e del Digital services act (Dsa) si chiudano entro aprile, così da avere un punto in più da rivendicare in vista delle presidenziali. Non arrivare a un’intesa entro quella data, inoltre, potrebbe voler dire un ulteriore posticipo della decisione, con la Francia concentrate sulle proprie elezioni.

Per di più, Parigi non solo deve portare a casa l’approvazione dei due testi in breve tempo ma deve anche adattarli al palato statunitense. SIa i democratici che i repubblicani sono ampiamente contrari a una regolamentazione che andrebbe a discapito delle sole aziende americane. Insomma, la sfida del digitale, per essere vinta, necessita inevitabilmente di un dialogo tra le parti. Ma al momento a far rumore è il silenzio sulla linea Bruxelles-Washington.