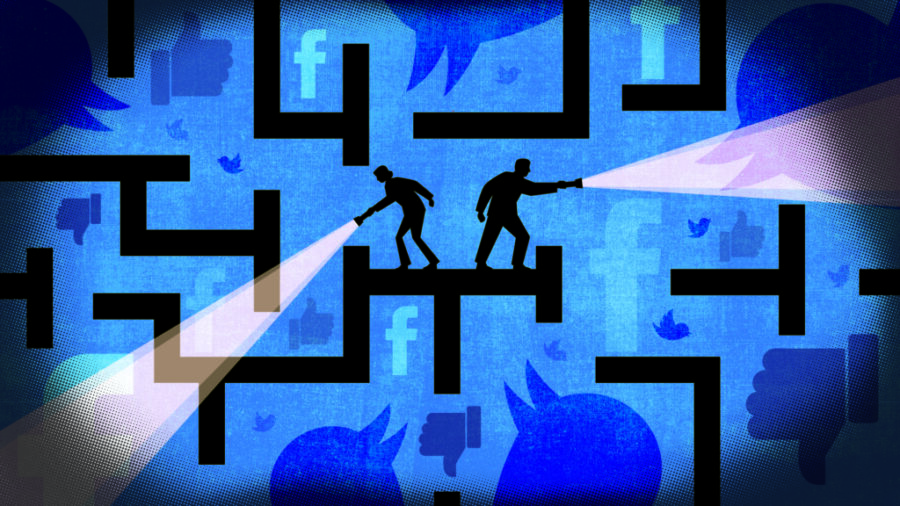

L’invasione russa ha dato un impulso agli sforzi europei contro propaganda, bot, fake news e deepfake. Sono in arrivo nuove misure per le Big Tech: in Ue dovranno potenziare i loro strumenti e rendere conto della loro strategia anti-disinformazione Paese per Paese, lingua per lingua

Dopo anni di dibattiti e inazione, sembra che stia per arrivare una vera svolta nella lotta alla disinformazione online. Giovedì l’Unione europea pubblicherà un documento che nel giro di pochi mesi costringerà le aziende Big Tech a intervenire in maniera più severa e trasparente su bot, fake news e contenuto inautentico, in qualsiasi lingua. Pena sanzioni pesantissime in caso di inadempienza.

La misura è l’ultimo episodio della stretta di Bruxelles sulle grandi aziende tech, divenute i vettori principali dell’informazione nell’era digitale, e contro la marea montante di notizie false e propaganda. Reuters e il Financial Times, che hanno messo le mani sul documento confidenziale, rivelano che Facebook, Twitter, Google, Microsoft e TikTok sono tra i trenta firmatari dell’aggiornamento del codice di condotta sulla disinformazione.

Quel documento sta per diventare uno schema di co-regolamentazione, inaugurando un regime in cui regolatori e firmatari si divideranno la responsabilità. Il nuovo codice, che entrerà in vigore a sei mesi da giovedì, andrà a complementare il Digital Services Act (che detta nuove regole su limiti e doveri delle piattaforme) e si avvantaggerà del suo sistema sanzionatorio, che prevede multe fino al 6% del fatturato globale.

I firmatari dovranno implementare una serie di misure per limitare la diffusione di “disinformazione dannosa” sviluppando strumenti e collaborazioni con i fact-checkers. Le azioni possono includere l’eliminazione della propaganda e del materiale inautentico, come i deepfake. Oppure l’inclusione di “indicatori di affidabilità” sulle informazioni verificate in modo indipendente su questioni cruciali, come la guerra in Ucraina e il Covid-19.

Le aziende saranno anche obbligate ad adeguarsi alle nuove regole di trasparenza: dovranno spiegare in che modo rimuovono, bloccano o limitano la diffusione di contenuti dannosi, come funzionano i sistemi di intelligenza artificiale utilizzati per estirpare le fake news, quanti bot vengono eliminati, quanti moderatori vengono impiegati. Tutto questo vale per i post organici come per le pubblicità.

Inoltre – qui la svolta fondamentale – si prevede una divisione Paese per Paese nei rapporti per la trasparenza. “Per rispondere alla disinformazione in modo efficace, sono necessari dati specifici per ogni Paese e lingua. Sappiamo che la disinformazione è diversa in ciascun Paese”, ha detto Věra Jourová, commissaria europea per i valori e la trasparenza, spiegando che “le grandi piattaforme dovranno fornire dati significativi che permettano di comprendere meglio la situazione a livello nazionale”.

È un cambio di passo inaspettato: la lotta alla disinformazione costa in termini di risorse e personale dedicato. È vero che negli ultimi anni le piattaforme sono migliorate parecchio nel contrastare le fake, ma a beneficiarne è stata soprattutto l’anglosfera, dove la pressione politica era maggiore. Tra qualche mese, invece, dovranno svelare come conducono il monitoraggio Paese per Paese – cosa che dovrebbe spingerle a potenziare gli strumenti anti-disinformazione in più lingue.

Questa è l’ennesima svolta tecno-politica catalizzata dall’invasione russa dell’Ucraina, dopo il fronte comune Ue-Usa in seno al Ttc. Jourová ha detto che la spinta propagandistica del Cremlino ha reso le discussioni per rafforzare il codice più urgenti. “Una volta che il codice sarà operativo, saremo più preparati ad affrontare la disinformazione, anche quella proveniente dalla Russia”.