Ha fatto scalpore, durante l’estate 2017, l’appello presentato all’Onu da più di cento imprenditori attivi nel settore dell’intelligenza artificiale, compreso Elon Musk, perché si fermi la corsa ai robot bellici. Le ragioni di questo appello sono molteplici e, a leggerlo bene tra le righe, un po’ di sana paura viene. Intanto, un soldato-robot può combattere senza sosta, a differenza degli esseri umani che fanno i turni per ragioni di stanchezza: si potrebbe sostenere che anche i robot esauriscono le batterie, ma certamente avranno un’autonomia ben maggiore delle misere 12 ore umane. Questo può comportare un’intensità qualitativa e quantitativa, di scala temporale e d’azione, del tutto inconcepibile fino ad oggi in una guerra non automatizzata o comunque non intelligente.

Trovo interessante che, nel breve appello, si tocchi il tema della “velocità” delle armi robotizzate intelligenti come qualcosa che potrebbe non lasciare neppure il tempo, agli esseri umani, di capire cosa stia succedendo.

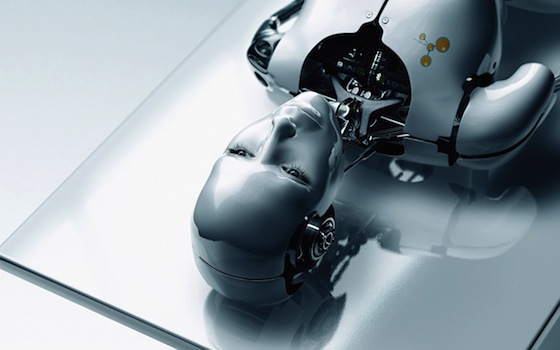

Se vogliamo aggravare il quadro, alle preoccupazioni precedenti si aggiunge quella dell’imprevedibilità delle decisioni dei robot: contrariamente a quanto si potrebbe pensare, l’artificiale non è prevedibile con certezza nelle sue determinazioni esperte e avanzate. Ogni rete neurale include meccanismi evolutivi e di calcolo che la rendono prevedibile solo su base probabilistica, esattamente come accade con la mente degli esseri umani. In buona sostanza, non possiamo dirci sicuri del fatto che il robot farà questo o quello, e solo questo e solo quello, perché “farà anche di testa sua”. Finché si tratta del robottino che prepara la cena o spreme gli agrumi, passi: ma quando parliamo di RoboCop o Terminator 4.0, i rischi impennano.

Già oggi si usano, nei teatri di guerra, i droni e i missili telecomandati o teleprogrammati. Però siamo ancora a livelli di intelligenza minimi: buona parte del lavoro lo fanno gli esseri umani, i militari telecomandanti, mentre i parametri di volo e di targeting – affinché si colpisca con precisione uno specifico obiettivo – sono sì evoluti ma assolutamente non affidati all’autonomia artificiale di reti neurali.

Inoltre, il soldato-robot intelligente non ha, tendenzialmente, altre caratteristiche tipiche dell’essere umano, il che lo rende ancora più pericoloso: non sente male fisico né, almeno fino ad un’improbabile (ma comunque possibile) evoluzione neurale, alcun dolore morale. Questo significa che gli manca, in linea di principio, la capacità di provare l’emozione di base, innata, della paura: tutti noi esseri umani veniamo al mondo piccoli, inermi, vulnerabili, senzienti e capaci di paura, mentre dobbiamo costruire passo dopo passo, maturando, il nostro coraggio (che non è un elemento primario); viceversa, i robot nascono con coraggio, armi, struttura già formata – ma senza il dono della paura.

La mancanza di male fisico e morale, e quindi di paura, rende probabilmente un robot intelligente – se non altro in fasi di immaturità psichica – assai stupido emotivamente. La stupidità emotiva si traduce in: nessun timore di farsi male essendo colpito dal nemico, istinto di conservazione quasi nullo, ma soprattutto impossibilità di crisi di coscienza.

Quante tragedie sono state rese meno tragiche, quante guerre (o baruffe private) sono finite prima, per “ragioni di coscienza”? Quante obiezioni di coscienza hanno salvato vite? Non è dato saperlo, ma qualcosa mi dice – anche ascoltando certi racconti di nonni e bisnonni sulla Seconda Guerra Mondiale o leggendo ricostruzioni storiche di vicende belliche – che la coscienza umana sia stata in più occasioni un ingrediente provvidenziale per evitare distruzioni e crudeltà ancora peggiori.

Quello che siamo abituati a definire come “ragionevolezza” è in realtà ben poco legato alla ragione e moltissimo al sentimento. Lo dico da avvocato, e gli avvocati – come noto – di liti se ne intendono. Coi robot, scordiamocelo. O aspettiamoci scarsa sensibilità emotiva, come minimo. La e-pace sarà difficile.